Dil işleme modelleri, doğal dil işleme (NLP) araştırmalarında ve uygulamalarında önemli bir araç haline gelmiştir. XLM-RoBERTa, RoBERTa mimarisine dayanan ve XLM algoritması kullanılarak oluşturulan son derece gelişmiş bir yapay zeka dil işleme modelidir. XLM-RoBERTa modeli, dil anlama, makine çevirisi ve metin sınıflandırma da dahil olmak üzere çeşitli çok dillli NLP görevlerinde etkileyici performans sergilemiştir. Bu model, genellikle tek bir dil veya küçük bir dil kümesiyle sınırlı olan geleneksel dil işleme modellerinin sınırlamalarını aşmak amacıyla tasarlanmıştır. XLM-RoBERTa modeli, çoklu dillerden büyük miktarda veriyle eğitilerek, yeni dillere son derece uyumlu ve çapraz-dil görevlerinde daha etkili bir hale getirilmiştir. XLM-RoBERTa modeli, NLP topluluğundaki araştırmacılar ve uygulayıcılar tarafından geniş çapta benimsenmiş olup, başarısı çok dillli NLP uygulamaları için yeni olanaklar sunmuştur. Bu makalede, XLM-RoBERTa modelinin temel özelliklerini ve faydalarını keşfedeceğiz ve NLP alanındaki etkisini inceleyeceğiz.

XLM-RoBERTa, çapraz-dil dil modelleme için XLM algoritmasını kullanan RoBERTa mimarisine dayanan bir yapay zeka dil işleme modelidir.

XLM-RoBERTa, birden fazla dilin metin verisini kullanarak eğitim yaparak çalışır, bu da onun çeşitli dillerde metinleri anlamasına ve işlemesine olanak sağlar.

RoBERTa mimarisi, dil modellemesi, sınıflandırma ve metin üretimi gibi doğal dil işleme görevlerini gerçekleştirmek için tasarlanmış bir sinir ağı mimarisidir.

XLM algoritması, modellerin birden fazla dilde metinleri anlaması ve işlemesi için kullanılan bir çapraz dilsel dil modelleme algoritmasıdır.

XLM-RoBERTa çeşitli dillerde metin işleme yapabilir, bu da makine çevirisi, duygu analizi ve bilgi erişimi gibi uygulamalar için kullanışlı hale getirir.

XLM-RoBERTa, birden fazla dili işlemesine olanak sağlayan XLM algoritmasını kullanması nedeniyle diğer dil işleme modellerinden farklıdır.

XLM-RoBERTa'nın eğitim süreci, birden fazla dildeki büyük miktarda metin verisini modele beslemeyi ve sinir ağındaki ağırlıkları ayarlayarak modelin bir cümledeki bir sonraki kelimeyi doğru bir şekilde tahmin edebilmesini sağlamayı içerir.

XLM-RoBERTa, makine çevirisi, metin sınıflandırma, duygu analizi ve bilgi geri çekme gibi çeşitli uygulamalar için kullanılabilir.

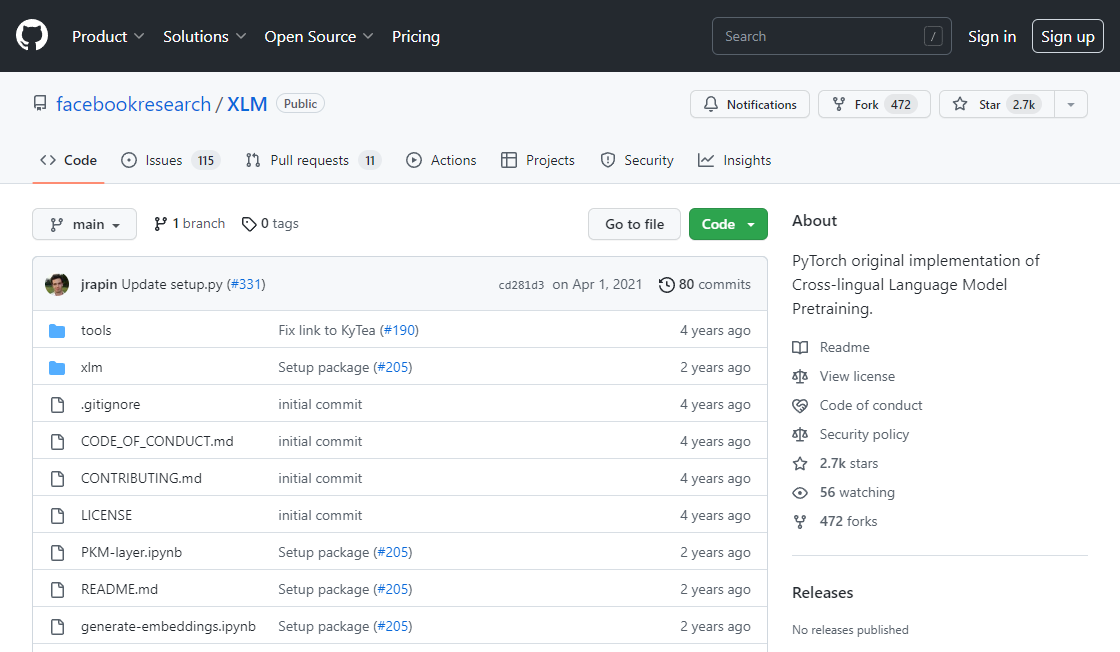

Evet, XLM-RoBERTa geliştiriciler ve araştırmacılar için ücretsiz olarak kullanılabilen bir açık kaynaklı projedir.

Evet, XLM-RoBERTa duygusal analiz veya makine çevirisi gibi belirli görevler için ayarlanabilir. Bunun için, eldeki görevle ilgili daha küçük bir veri kümesiyle eğitilerek kullanılabilir.

| Rakip | Açıklama | Fark |

|---|---|---|

| BERT | BERT, transformer mimarisine dayanan popüler bir AI dil işleme modelidir. XLM-RoBERTa'nın aksine, BERT tek dillidir ve İngilizce dil verileri üzerinde eğitilmiştir. | XLM-RoBERTa birden fazla dil anlayabilen bir çapraz-dilsel modeldir, oysa ki BERT yalnızca İngilizce ile sınırlıdır. |

| GPT-3 | GPT-3, OpenAI tarafından geliştirilen son teknoloji bir AI dil işleme modelidir. XLM-RoBERTa'ya benzer bir transformer-tabanlı mimari kullanır, ancak çapraz-dilsel değildir. | XLM-RoBERTa birden fazla dil anlayabilirken GPT-3 yalnızca İngilizce ile sınırlıdır. |

| T5 | T5, Google tarafından geliştirilen transformer-tabanlı bir AI dil işleme modelidir. Çeviri, özetleme ve soru-cevaplama gibi çeşitli doğal dil görevlerini gerçekleştirmek üzere tasarlanmıştır. XLM-RoBERTa'nın aksine, T5 çapraz-dilsel değildir. | XLM-RoBERTa birden fazla dil anlayabilen bir modeldir, oysa ki T5 belirli dil görevleri ile sınırlıdır. |

| ALBERT | ALBERT (A Lite BERT), daha verimli ve daha az parametreye sahip olacak şekilde tasarlanmış bir BERT'in modifiye edilmiş bir versiyonudur. BERT gibi monodildir. | XLM-RoBERTa birden fazla dil anlayabilen bir çapraz-dilsel modeldir, oysa ki ALBERT yalnızca İngilizce ile sınırlıdır. |

XLM-RoBERTa, RoBERTa mimarisini kullanan gelişmiş bir yapay zeka dil işleme modelidir. Farklı dillerden veri işleyebilmesini sağlayan XLM algoritmasına dayanan bir çapraz dil modelidir.

XLM-RoBERTa modeli, çeşitli dillerde doğal dil metinlerini anlamak ve yorumlamak için tasarlanmıştır. Büyük bir metin biriktirme üzerinde eğitildiği için, kelimelerin ve ifadelerin anlamını bağlama uygun bir şekilde tahmin etme yeteneğine sahiptir.

XLM-RoBERTa'nın temel avantajlarından biri, aynı anda birden fazla dil işleyebilme yeteneğidir. Bu, ayrı ayrı dil modellerine ihtiyaç duymadan, sosyal medya, haber makaleleri ve akademik araştırma makaleleri gibi farklı kaynaklardan metinleri analiz edebileceği anlamına gelir.

XLM-RoBERTa modeli, makine çevirisi, duygu analizi ve metin sınıflandırma gibi geniş bir uygulama yelpazesinde kullanılmıştır. Ayrıca, ses tanıma sistemlerinin ve sohbet botlarının doğruluğunu artırmak için de kullanılmıştır.

Genel olarak, XLM-RoBERTa, geleneksel dil modellerine göre önemli avantajlar sunan doğal dil işleme için güçlü bir araçtır. Birden fazla dil işleyebilme yeteneği ve kelimelerin ve ifadelerin bağlamında anlamını doğru bir şekilde tahmin edebilme yeteneği, küresel pazarda faaliyet gösteren işletmeler ve organizasyonlar için değerli bir varlık yapar.

Topluluk için bir inceleme bırakın