Megatron-LM, Doğal Dil İşleme (NLP) alanında dikkate değer bir teknolojik gelişmedir. Bu, 8 milyon web belgesinin büyük çapta bir önbilgilenme üzerine eğitilmiş bir dönüştürücü modelidir. Bu son teknoloji, doğal dil verilerini işlemeyi ve analiz etmeyi devrim yapabilecek potansiyele sahiptir. Megatron-LM, idiyomatik ifadeler, sarkazm ve ironi gibi insan dilinin inceliklerini anlamak için tasarlanmıştır. Model, derin sinir ağı mimarisi üzerine inşa edilmiş olup, girdi metnin anlayışını artırmak için dikkat mekanizmaları ve öz-dikkat gibi gelişmiş tekniklerden yararlanır. Kapsamlı ölçekte ve gelişmiş özellikleriyle Megatron-LM, NLP alanında devrim yaratan bir teknoloji haline gelmiştir. Metin sınıflandırma, soru-cevap sistemleri ve dil çevirisi dahil olmak üzere birçok farklı uygulama için kullanılabilir. Bu makalede, Megatron-LM'nin çeşitli yönleri ve NLP alanındaki etkisi incelenecektir.

Megatron-LM, büyük ölçekli bir doğal dil işleme (NLP) transformer modelidir.

Megatron-LM, 8 milyon web belgesinde ön eğitime tabi tutuldu.

Megatron-LM, dil modellemesi, metin sınıflandırma ve makine çevirisi gibi NLP görevleri için kullanılır.

Megatron-LM şu anda mevcut olan en büyük ve güçlü NLP modellerinden biridir ve büyük miktarda veriyi işleme yeteneğine sahiptir.

Megatron-LM, sosyal medya gönderilerini analiz etmekten, sohbet botlarında doğal dil yanıtları üretmeye kadar geniş bir NLP görevleri yelpazesinde kullanılabilir.

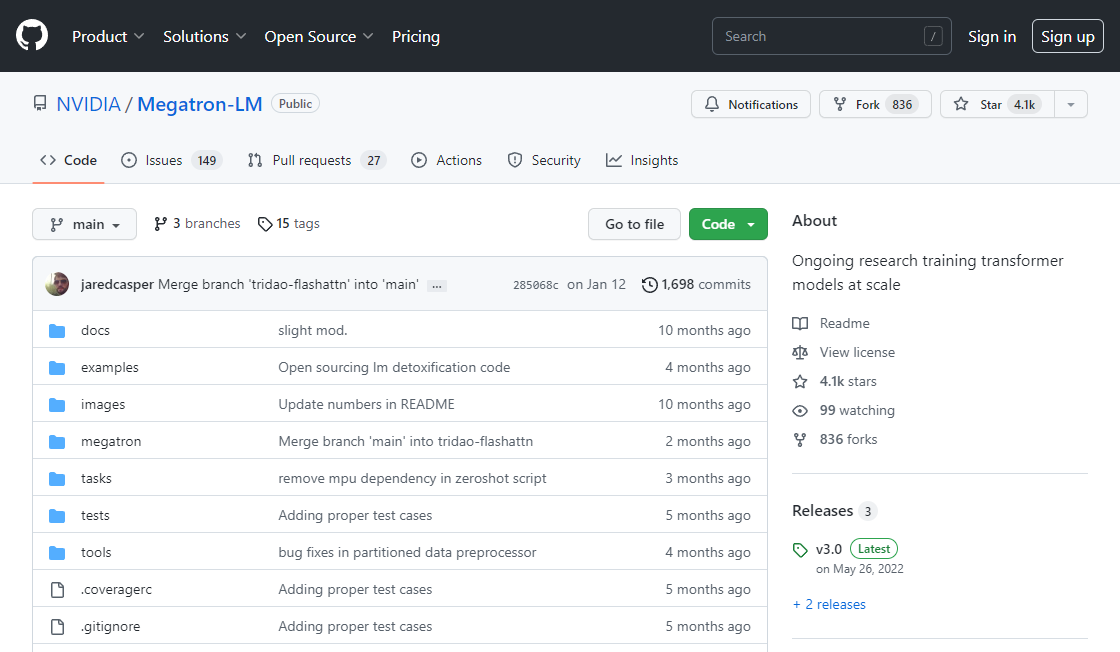

Evet, Megatron-LM herkesin ücretsiz olarak kullanabileceği açık kaynaklı bir projedir.

Evet, Megatron-LM, göreve ilişkin daha küçük bir veri seti üzerinde eğitilerek belirli NLP görevleri için ayarlanabilir.

Megatron-LM, Python, C++ ve CUDA dahil olmak üzere çeşitli programlama dillerini desteklemektedir.

Megatron-LM, en az 16GB belleğe sahip bir GPU ve önceden eğitilmiş model için geniş bir depolama alanı gerektirir.

Megatron-LM, grafik işlem birimleri (GPU'lar) ve yapay zeka konusunda uzmanlaşmış önde gelen bir teknoloji şirketi olan NVIDIA'daki araştırmacılar tarafından geliştirilmiştir.

| Rakip | Açıklama | Ön eğitim veri boyutu |

|---|---|---|

| GPT-3 | OpenAI tarafından geliştirilmiş bir transformer tabanlı dil modeli | 570 GB metin verisi |

| T5 | Google tarafından geliştirilmiş bir transformer tabanlı dil modeli | 750 GB metin verisi |

| BERT | Google tarafından geliştirilmiş bir transformer tabanlı dil modeli | 3.3 milyar kelime |

| RoBERTa | Facebook tarafından geliştirilmiş bir transformer tabanlı dil modeli | 160 GB metin verisi |

Megatron-LM, etkileyici 8 milyon web belgesi üzerinde önceden eğitilmiş olan bir son teknoloji doğal dil işleme (NLP) transformer modelidir. Bu gelişmiş teknoloji, büyük miktarda metin verisini işleme kapasitesine sahip olup ondan anlamlı bilgiler çıkarabilir.

Megatron-LM'nin ana avantajlarından biri, araştırmacıları ve işletmeleri büyük veri kümelerini analiz etmeye ve değerli bilgileri hızlı ve verimli bir şekilde çıkarmaya yardımcı olabilmesidir. Özellikle makine öğrenimi, yapay zeka ve veri bilimi gibi alanlarda oldukça faydalı olabilir.

Megatron-LM'nin bir diğer önemli özelliği, deyimsel ifadeler ve argo dahil olmak üzere karmaşık dil yapılarını işleyebilme yeteneğidir. Bu, sosyal medya verileri, müşteri geri bildirimleri ve diğer yapılandırılmamış metin türleri gibi analiz etmek için ideal bir araç yapar.

Bu avantajlara ek olarak, Megatron-LM ayrıca son derece özelleştirilebilir olup kullanıcıların modeli kendi ihtiyaçlarına uyacak şekilde ayarlamalarına olanak tanır. Bu, geniş bir uygulama yelpazesinde kullanılabilen son derece esnek bir araç yapar.

Genel olarak, büyük miktarda metin verisine daha derin bir bakış elde etmenize yardımcı olabilecek güçlü bir NLP transformer modeli arıyorsanız, Megatron-LM kesinlikle göz önünde bulundurulmaya değer. 8 milyon web belgesi üzerindeki önceden eğitimi, işleme gücü ve doğruluk açısından diğer modellere kıyasla avantaj sağlayarak, işletmeler ve araştırmacılar için mükemmel bir yatırım olmasını sağlar.

Topluluk için bir inceleme bırakın