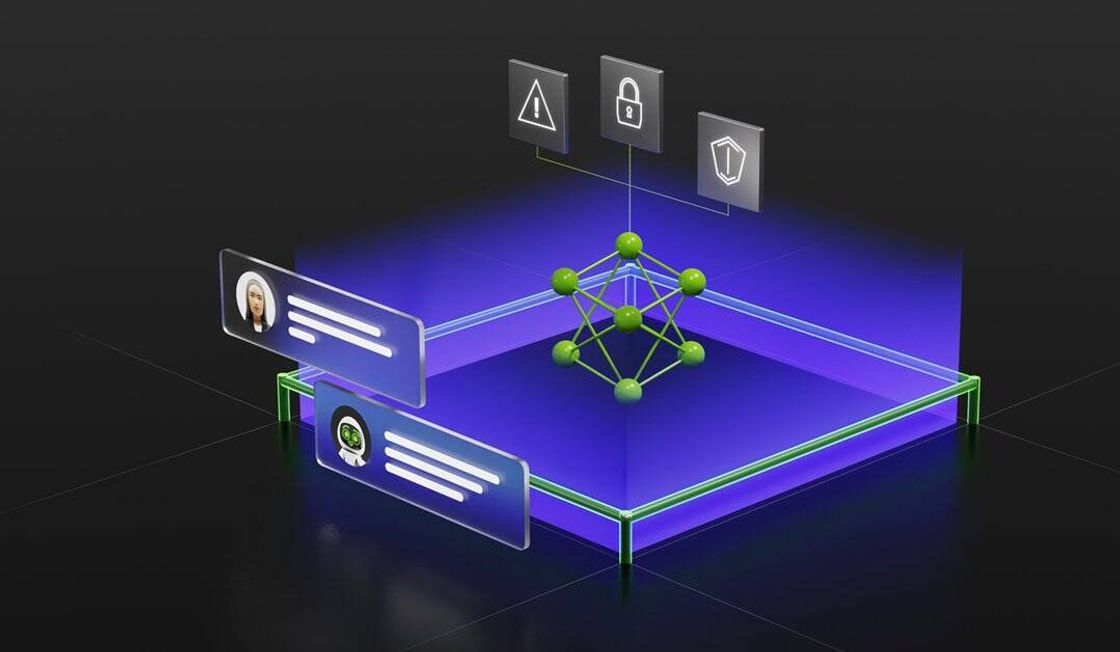

Son yıllarda büyük dil modelleri, doğal dil işleme görevlerinde en son teknoloji performansı sunmaları nedeniyle giderek daha popüler hale gelmiştir. Ancak, büyük güç, büyük sorumlulukla birlikte gelir. Bu modeller, nefret söylemi, yanlış bilgi ve diğer çevrimiçi istismar türleri gibi zararlı çıktılar da üretebilir. Bu sorunu hafifletmek için araştırmacılar, zararlı çıktıların üretilmesini engellemek için büyük dil modellerine korumalar ekleyen Guardrails AI adlı bir teknik geliştirmiştir. Guardrails AI, potansiyel zararlı çıktıları tespit ederek onları değiştirme veya tamamen önleme şeklinde çalışır. Bu yaklaşım, çevrimiçi istismara maruz kalan savunmasız bireyleri ve grupları korumakla kalmaz, aynı zamanda büyük dil modellerinin daha geniş toplumda sorumlu bir şekilde kullanılmasını sağlar. Bu makalede, Guardrails AI kavramını, faydalarını, sınırlamalarını ve potansiyel kullanım alanlarını ele alıyoruz. Ayrıca, böyle korumaların uygulanmasıyla ilişkili etik düşünceleri ve bu teknikyi daha etkili ve verimli hale getirmek için ele alınması gereken zorlukları tartışıyoruz.

Guardrails AI, büyük dil modellerine koruyucu bariyerler eklemek için kullanılan bir araçtır. Bu araç, dil modellerinin güvenli ve etik olmasını sağlar.

Dil modelleri, doğru şekilde izlenmediğinde zararlı veya önyargılı içerik üretebilir. Koruyucu bariyerlerin eklenmesi, içeriğin güvenli ve etik kalmasını sağlar.

Guardrails AI, dil modellerini izlemek ve düzenlemek için makine öğrenme algoritmalarının ve insan denetiminin bir kombinasyonunu kullanır.

Guardrails AI, etik ve yasal uyumluluk, güvenlik ve gizlilik için korumalar ekleyebilir.

Hayır, Guardrails AI, boyutundan bağımsız olarak tüm dil modelleri için kullanılabilir.

Organizasyonlar, işletmeler ve dil modellerini kullanan bireyler, içeriklerinin güvenli ve etik olmasını sağlamak için Guardrails AI'dan faydalanabilirler.

Hayır, Guardrails AI herkes tarafından kullanıcı dostu ve erişilebilir olacak şekilde tasarlanmıştır.

Guardrails AI zararlı veya önyargılı içeriklerin üretilme olasılığını azaltabilir, ancak %100 önlem garantisi sağlayamaz.

Evet, Guardrails AI kullanımıyla bir maliyeti bulunmaktadır. Fiyatlandırma, dil modelinin boyutu ve karmaşıklığına bağlı olarak değişiklik gösterir.

Guardrails AI çoğu dil modeliyle uyumlu olacak şekilde tasarlanmıştır, bunlar arasında doğal dil işleme (NLP) modelleri ve sohbet botları bulunur.

| Rakip | Açıklama | Fark |

|---|---|---|

| Kucaklayan Yüz Dönüşümler | Doğal Dil İşleme görevleri için açık kaynaklı kütüphane ve topluluk | Guardrails AI dil modelleri için belirli kısıtlamalar sağlar |

| IBM Watson Doğal Dil Anlama | Doğal Dil İşleme analizi için bulut tabanlı platform | Guardrails AI mevcut dil modellerine kısıtlamalar eklemeye odaklanır |

| Google Cloud Doğal Dil API'si | Metinden içgörüler çıkarmak ve analiz etmek için araç | Guardrails AI özellikle model önyargısı ve yanlış kullanımı ele almak için tasarlanmıştır |

| Microsoft Azure Bilişsel Hizmetler Metin Analitiği | Metin analitiği, duygu analizi ve anahtar kelime çıkarımı için API | Guardrails AI model önyargısı ve yanlış kullanımı için daha kapsamlı bir çözüm sunar |

| Amazon Comprehend | Metin verilerini analiz etmek için NLP hizmeti | Guardrails AI dil model davranışını düzenlemek için benzersiz bir yaklaşım sunar |

Guardrails AI, yapay zeka dünyasında dikkat çeken bir teknolojidir. Büyük dil modellerine güvenlik önlemleri veya koruyucu bariyerler eklemek için tasarlanmıştır. Bu önlemler, zararlı veya yanlı içerik üretmelerini önlemektedir.

Guardrails AI hakkında bilmeniz gereken bazı şeyler şunlardır:

1. Guardrails AI, büyük dil modelleri için oyunu değiştiriyor

GPT-3 gibi büyük dil modelleri, doğal dil işlemeyi devrimlendirebilecek potansiyele sahiptir. Ancak, zarar verme potansiyelleri de bulunmaktadır. Çünkü yanlış, yanıltıcı veya saldırgan metinler üretebilirler. Guardrails AI, bu riskleri azaltmak için bu modellere güvenlik önlemleri eklemektedir.

2. Guardrails AI, hedeflerine ulaşmak için çeşitli teknikler kullanır

Guardrails AI, büyük dil modellerine güvenlik önlemleri eklemek için çeşitli teknikler kullanmaktadır. Bunlar, zararlı veya yanlı içeriği tespit etmek için işaretlenmiş veri kümelerinde modellerin eğitilmesini, zayıflıkları test etmek için düşmanca saldırıları kullanmayı ve sürekli iyileştirmeyi sağlamak için geri besleme mekanizmalarını içerir.

3. Guardrails AI, mevcut modellerle uyumlu olacak şekilde tasarlanmıştır

Guardrails AI'nın harika özelliklerinden biri, mevcut GPT-3 gibi büyük dil modelleri ile uyumlu olacak şekilde tasarlanmış olmasıdır. Bu, önemli değişiklikler gerektirmeksizin mevcut iş akışlarına entegre edilebilmesi anlamına gelir.

4. Guardrails AI, yapay zekaya olan güveni artırma potansiyeline sahiptir

Bugün yapay zekanın karşı karşıya olduğu büyük zorluklardan biri, güvensizliktir. Bu durum büyük ölçüde yanlılık, adalet ve güvenlik endişeleriyle ilgilidir. Büyük dil modellerine güvenlik önlemleri ekleyerek, Guardrails AI, bu endişeleri hafifletme potansiyeline sahiptir.

5. Guardrails AI hala geliştirme aşamalarında bulunmaktadır

Guardrails AI büyük bir potansiyele sahip olmasına rağmen, hala geliştirme aşamalarında bulunmaktadır. Bu nedenle, zarar ve yanlılık konularında etkili olmasını sağlamak için teknolojiyi sürekli olarak iyileştirmek ve test etmek önemlidir.

Sonuç olarak, Guardrails AI, büyük dil modelleri ile ilişkili riskleri azaltma potansiyeline sahip olan umut verici bir teknolojidir. Bu modellere güvenlik önlemleri ekleyerek, Guardrails AI, yapay zekaya olan güveni artırabilir ve daha sofistike doğal dil işleme uygulamalarının geliştirilmesine olanak tanıyabilir.

Topluluk için bir inceleme bırakın