BERT, Türkçe karşılığı "Transformerlar ile İki Yönlü Kodlayıcı Temsilleri" olan Bidirectional Encoder Representations from Transformers'ın kısaltmasıdır. Google tarafından geliştirilen güçlü bir araçtır. Bu araç, doğal dil işleme (NLP) görevlerini, metin sınıflandırma, soru cevaplama ve varlık tanıma gibi görevleri kolaylaştırmak için son derece gelişmiş derin öğrenme teknikleri kullanmaktadır. BERT, girdileri iki yönlü işleyebilme özelliğine sahip olmasıyla diğerlerinden farklıdır. Bu özellik sayesinde, sadece önceki veya sonraki kelimeleri değil, cümledeki bağlamı da dikkate alarak dilin anlamını anlayabilir ve daha doğru sonuçlar üretebilir. BERT'in kullanımı, NLP'nin devrimini gerçekleştirmiş olup çeşitli NLP modellerinin performansını artırmış ve geleneksel metotlara göre önemli avantajlar sağlamıştır. Etkinliği, arama motorları, sohbet botları, sanal asistanlar ve duygu analizi gibi birçok uygulamada gösterilmiştir. Bu makalede, BERT'in karmaşıklıklarını, temel özelliklerini ve NLP'deki potansiyel uygulamalarını keşfedeceğiz.

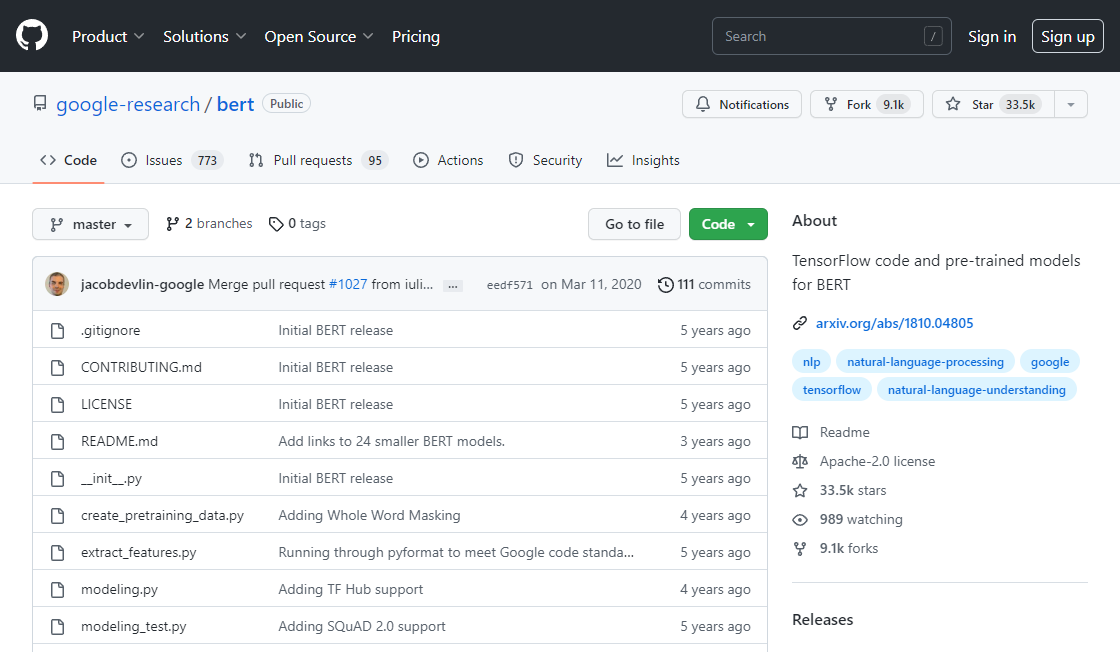

BERT, Google tarafından geliştirilen açık kaynaklı bir dil temsil modelidir. Türkçede Bidirectional Encoder Representations from Transformers olarak geçer.

BERT, işaretsiz metinden derin çift yönlü temsillemeleri ön eğitmek için bir dönüştürücü tabanlı bir mimari kullanır. Ardından, soru cevaplama ve duygusal analiz gibi çeşitli doğal dil işleme görevleri için ince ayar yapılabilir. .

BERT, çeşitli doğal dil anlama görevlerinde önemli gelişmeler göstermiş ve birçok kıyaslama benchmarkunda en iyi sonuçları elde etmiştir. Ön eğitim süreci aynı zamanda BERT'in geniş bir yelpazeye adapte olabilmesine olanak tanır.

Evet, BERT açık kaynaklı bir araçtır ve herkes tarafından ücretsiz olarak erişilebilir ve kullanılabilir.

BERT, çeşitli NLP görevlerinde yüksek düzeyde doğruluk elde etmiştir ve birçok benchmarkta önceki en gelişmiş modelleri geride bırakmıştır.

Evet, BERT çoklu dil verileriyle eğitildi ve çoklu dilleri anlayabilir.

BERT, soru cevaplama, duygu analizi, adlandırılmış varlık tanıma ve metin sınıflandırma gibi çeşitli NLP görevleri için ince ayar yapılabilir.

BERT, işletmelerin doğal dil işleme yeteneklerini iyileştirmelerine yardımcı olabilir, bu da daha doğru ve verimli müşteri hizmeti, duygu analizi ve içerik oluşturma sağlar.

BERT uygulamak belirli bir teknik bilgi gerektirse de, bu süreci kolaylaştırmak için birçok kütüphane ve kaynak bulunmaktadır.

BERT günümüzde mevcut olan en iyi NLP araçlarından biridir, ancak alanında sürekli yeni ilerlemeler ve gelişmeler vardır.

| Yarışmacı | BERT'ten Farkı |

|---|---|

| GPT-3 | OpenAI tarafından geliştirilen Generative Pre-trained Transformer 3, 175 milyar parametreye sahip bir dil modelidir ve BERT'ten çok daha büyüktür. |

| ELMo | Language Models'den Elde Edilen Gömütler, Allen Institute for Artificial Intelligence tarafından geliştirilen bir dil temsil modelidir ve bağlamsal kelime gömütleri oluşturmak için derin çift yönlü bir dil modeli kullanır. |

| ULMFiT | Universal Language Model Fine-tuning, Jeremy Howard ve Sebastian Ruder tarafından geliştirilen bir dil modelidir ve önceden eğitilmiş modelleri belirli doğal dil işleme (NLP) görevlerine uyarlamak için transfer öğrenmesini kullanır. |

| RoBERTa | Robustly Optimized BERT Approach, Facebook AI Research tarafından geliştirilen bir dil modelidir ve NLP görevlerinde daha iyi performans elde etmek için BERT'ten daha uzun eğitim süresi, daha büyük toplu işlem boyutları ve daha fazla hesaplama gücü kullanır. |

BERT, Bidirectional Encoder Representations from Transformers şeklinde kısaltılan bir inovatif açık kaynaklı dil temsil modelidir ve Google tarafından oluşturulmuştur. 2018 yılında doğal dil işleme (NLP) teknolojisinde bir çığır olarak tanıtılmış ve o zamandan beri arama motorları, sohbet botları ve sanal asistanlar da dahil olmak üzere çeşitli NLP uygulamalarında yaygın şekilde kullanılmaktadır.

BERT'in en önemli özelliği, çift yönlü yapısıdır, yani dilin hem soldan sağa hem de sağdan sola işlenmesini sağlayabilir. Bu, modele bir kelimenin veya ifadenin anlamını, ondan önce gelen ve ondan sonra gelen kelimeleri de dikkate alarak anlamasını sağlar. BERT, bunu doğal dil işleme görevlerinde çok etkili olduğu kanıtlanmış bir yapı olan dönüştürücü mimari kullanarak başarır.

BERT'in en önemli avantajlarından biri, idiomatik ifadeler, belirsiz ifadeler ve sentaktik değişkenlikler gibi karmaşık dil yapılarını işleme yeteneğidir. Bunun nedeni, BERT'in her kelimenin anlamını çevresindeki kelimelerle ilişkili olarak kodlamasıyla dilin inceliklerini yakalamasıdır. Sonuç olarak, bir cümlenin arkasındaki niyeti doğru bir şekilde yorumlayabilir ve daha ilgili yanıtlar sağlayabilir.

BERT'in bir başka önemli yönü, ön eğitim sürecidir, bu süreçte model büyük miktarda metin verisinde eğitilir. Bu, modelin geniş bir dilbilimsel özellik ve desenler yelpazesi öğrenmesini sağlar, bu da onu daha sağlam ve farklı bağlamlara uyum sağlayabilen kılar. Ayrıca, BERT, daha az miktarda göreve özgü veri kullanılarak belirli görevler için ince ayar yapılabilen, büyük miktarda eğitim verisi ihtiyacını azaltan bir yapıdır.

Özetlemek gerekirse, BERT, doğal dil işleme alanını devrim yaratan gelişmiş bir dil temsil modelidir. Çift yönlü yapısı, dönüştürücü mimari ve ön eğitim süreci, karmaşık dilbilimsel yapıları anlama ve doğru yanıtlar sağlama konusunda son derece etkilidir. Açık kaynaklı olmasıyla birlikte, BERT, geliştiriciler ve araştırmacılar için değerli bir kaynak haline gelmiş, NLP teknolojisinde daha da ilerlemelerin yolunu açmıştır.

Topluluk için bir inceleme bırakın